多模态AI革命:从文本到万物的智能理解

什么是多模态AI

多模态AI是指能够同时理解和处理多种类型数据(文本、图像、音频、视频等)的人工智能系统。2026年,这一领域正经历着爆发式发展。

技术突破

统一架构

python复制 class MultimodalTransformer(nn.Module): """ 统一多模态Transformer架构 """ def __init__(self, config): super().__init__() # 各模态编码器 self.text_encoder = TextEncoder(config.text) self.vision_encoder = VisionEncoder(config.vision) self.audio_encoder = AudioEncoder(config.audio) # 统一模态融合层 self.fusion_layers = nn.ModuleList([ CrossModalAttention(config.fusion) for _ in range(config.num_fusion_layers) ]) # 统一解码器 self.unified_decoder = AutoregressiveDecoder(config.decoder) def forward(self, text_tokens, image_pixels, audio_waveform): # 独立编码 text_feat = self.text_encoder(text_tokens) vision_feat = self.vision_encoder(image_pixels) audio_feat = self.audio_encoder(audio_waveform) # 模态融合 fused = torch.cat([text_feat, vision_feat, audio_feat], dim=1) for layer in self.fusion_layers: fused = layer(fused) # 统一解码 output = self.unified_decoder(fused) return output

关键能力

- 跨模态检索: 用文字找图片,用图片找视频

- 模态转换: 文本生成图像、图像生成视频

- 联合推理: 结合视觉和语言进行复杂推理

- 实时交互: 低延迟的多模态对话

应用场景

内容创作

- AI导演: 自动生成视频分镜和脚本

- 智能剪辑: 根据语义自动剪辑视频

- 虚拟主播: 实时生成口型同步的虚拟形象

教育培训

- 智能助教: 理解学生手写笔记和语音提问

- 实验模拟: 多模态交互的虚拟实验室

- 语言学习: 结合视觉场景的语言沉浸式学习

医疗健康

- 医学影像分析: 结合病历文本和影像资料

- 手术辅助: 实时多模态手术导航

- 康复训练: 视觉+语音的个性化康复方案

主流模型对比

| 模型 | 发布方 | 模态支持 | 特点 |

|---|---|---|---|

| GPT-5V | OpenAI | 文本+图像+音频 | 推理能力强 |

| Gemini 2.0 | 文本+图像+视频+音频 | 上下文窗口大 | |

| Qwen-VL-Max | 阿里 | 文本+图像+视频 | 中文优化好 |

| InternVL-3 | 商汤 | 文本+图像+视频 | 开源可商用 |

发展趋势

短期(6-12个月)

- 视频理解能力大幅提升

- 实时多模态对话普及

- 端侧多模态模型优化

中期(1-2年)

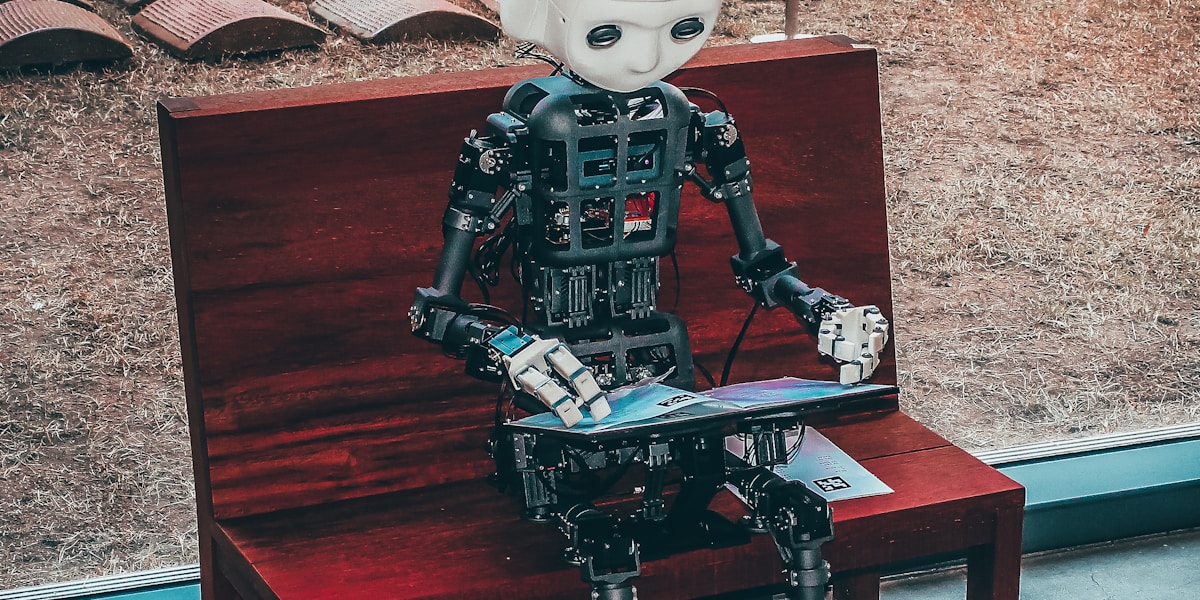

- 具身智能与多模态结合

- 多模态Agent自主决策

- 工业级多模态应用落地

长期(3-5年)

- 通用多模态世界模型

- 跨模态知识自动迁移

- 人机自然交互新范式

开发者建议

- 掌握基础: 深入理解Transformer和注意力机制

- 关注开源: 跟踪LLaVA、Qwen-VL等开源项目

- 实践为王: 多动手做跨模态应用项目

- 垂直深耕: 在特定领域建立多模态应用优势

多模态AI正在重新定义人机交互的边界,这是每个AI从业者都不能忽视的技术浪潮。

王

王涛博士

清华大学AI研究员,专注NLP方向